spark读取目录及子目录中文件

时间:2020-07-21 16:40:00

spark读取目录及子目录中文件?接下来教大家spark如何读取目录及子目录中文件。

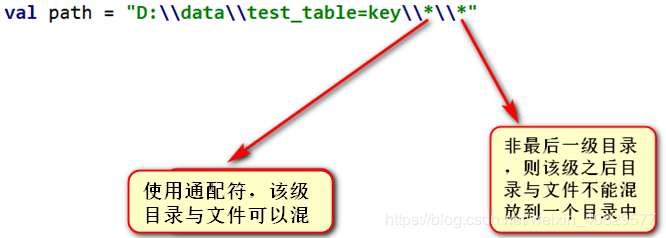

在spark输入1 val rdd=spark.sparkContext.textFile("D:\\data\\test_table\\*=1,D:\\data\\test_table\\key=2")

注意:

每个路径都要定位到最后一级。

路径之间不能存在包含关系。

目录与文件不要混放,即放在同一个目录下。

路径中可使用通配符。